[No.60]MetaはマルチタスクAIを開発、単一のアルゴリズムがイメージとテキストとボイスを理解する、メタバース開発のブレークスルーとなるか

MetaのCEOであるMark Zuckerbergは、メタバースを生成するためのAIについて明らかにした。

メタバースは、イメージやテキストやボイスなど、マルチメディアで構成される仮想空間で、これらがAIにより生成される。

異なる媒体を処理するためには、異なるAIが使われるが、Metaはこれを統合し、単一のAIがイメージやテキストやボイスを処理できるモデルを開発している。

これは「Unified Model(統合モデル)」と呼ばれ、アルゴリズムがマルチメディアの世界を理解し、3D仮想社会をリアルに生成する。

Unified Modelとは

Unified Modelとは、AIの異なるモードを統合した単一のAIモデルを指す。

このAIは「Data2Vec」と命名され、イメージやテキストやボイスなど、異なる媒体のデータを処理することができる。

現在は、媒体が異なると、それぞれ専用のAIモデルを使う。

例えば、イメージを処理するためには「NASNet」など画像処理専用のアルゴリズムを使う。

また、テキストの解析であれな「GPT-3」など、自然言語解析のアルゴリズムを使う。

これに対し、Unified Modelは、単一のアルゴリズム「Data2Vec」が、イメージやテキストやボイスを処理する機能を持ち、統合型のモデルとなる。

Unified Modelの仕組み

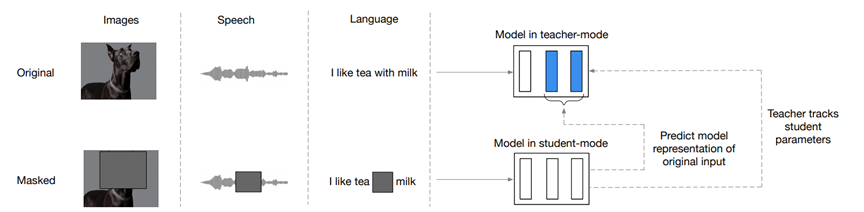

Data2Vecは「Transformer」をベースとするニューラルネットワークで、「教師モード(Teacher Mode)」と「生徒モード(Student Mode)」の二つのモードで構成される(下の写真)。

教師モードは先生で、生徒モードである生徒にスキルを伝授する。

まず、教師モードは入力データ(写真、音声、文字)を学習し、その結果(Latent Representations)を得る(上段)。

次に、生徒モードは、一部が欠けているデータを読み込み、その処理を実行し、それが何であるかを判定する(下段)。

生徒モードの処理結果と教師モードの処理結果を比較し、生徒は先生が示す手本に近づくようスキルを磨く。

データをマスクして教育

生徒モードの教育では、入力データとして一部がマスクされているデータを使う。

生徒モードのアルゴリズムは、このマスクされたデータから、オリジナルのデータを推測する。

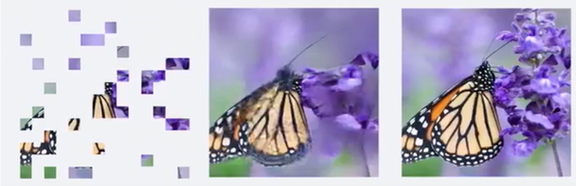

例えば、写真であれば、イメージの一部がマスクされたものを使い(下の写真左側)、ここから元の写真のイメージを推測する(中央)。

正解のイメージ(右端)と比較して、生徒モードのアルゴリズムは精度を上げていく。

同様に、スピーチやテキストでも、データの一部がマスクされ、生徒モードのアルゴリズムは、欠けている部分を推測することで判定精度を向上する。

Self-Supervised Learning

これは「Self-Supervised Learning」という学習方法で、AIが人間の介在無しに自分で学習し、スキルを習得する。

MetaはSelf-Supervised Learning をAI開発の基本戦略とし、インテリジェントなAIを開発している。

一般には、「Supervised Learning」という学習モデルを使ってAIが開発されている。

Supervised Learningとは、人間がアルゴリズム教育のためのデータ(タグ付きデータ)を用意し、これを使ってAIを開発する方式を指す。

これに対し、Self-Supervised Learningは、タグ付きの教育データを用意する必要はなく、アルゴリズムが人間の介在なく、独自で学習する。

このため、大量のデータを教育データとして使うことができ、大規模なアルゴリズムの開発が可能となる。

MetaはSelf-Supervised Learningが、インテリジェンスを得るための手法として、この方式のAI開発を重点的に進めている。

リアルな仮想社会

Metaはメタバースのコンセプトを発表したが、Unified Modelがこれを支えるプラットフォームとなる。

Metaは、メタバースで遠隔地の友人とフェンシングをするイメージをを公開した(上の写真)。

ARグラスと触覚技術を着装すると、目の前に遠隔地の対戦者が描写され(左側の人物)、剣が触れ合う感触が、リアルに生成される。

これは、マルチメディアに触覚情報を加えたもので、剣で仮想の相手を突いた時の感触が再生される。

メージとテキストとボイスの次はセンシングデータで、Unified Modelがこれらのメディアを理解し、リアルな仮想社会を描き出す。