最新世代の NVIDIA GPU をラインナップ

AI、生成AI、シミュレーション、CAD、3DCG、映像編集、VRなど、高い演算性能が求められるプロフェッショナル用途に向けたNVIDIA GPU を幅広く取り扱っています。

GPU単体でのご購入はもちろん、

GPU搭載ワークステーションやGPUサーバーと組み合わせた構成でのご提供にも対応しています。

また、1ヵ月から利用可能なGPUレンタル(月額)もご用意しており、

「短期間だけ使いたい」

「実業務でGPU性能を検証したい」

「固定資産として保有せずに運用したい」

といったニーズにも柔軟に対応します。

なお、サーバーやデータセンター向けGPUを、オフィス環境や居室でも静音かつ安定して運用したい方向けに、GPUを液冷化した液冷GPUワークステーション「AquSys(アクシス)シリーズ」もご提供しています。

用途や環境に応じたGPUの選定から、組み込み、動作確認まで対応し、届いたその日からGPUを活用いただける環境をお届けします。

NVIDIA GPU 一覧PDF ダウンロード

弊社が取り扱っている「NVIDIA GPU」 の性能、スペックを一覧にしています。

NVIDIA GPUの導入を検討される際の参考にご活用ください。

※GPUの参考価格は、各GPUの製品ページまたは、GPUレンタルページよりご確認ください。

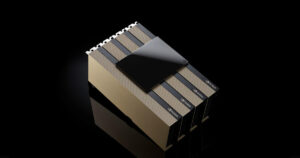

NVIDIA H200 NVL 141GB

NVIDIA H200 NVL 141GBはHBM3eメモリとNVLinkを備えた生成AI・大規模言語モデル(LLM)・HPC向け次世代GPU。H100比で推論最大約1.9倍、メモリ帯域4.8TB/s。対応システムのご相談はGDEPソリューションズへ。

NVIDIA H100 NVL 94GB

NVIDIA H100 GPU(NVIDIA H100 NVL)は、94GBのGPUメモリが搭載されており、2基のNVIDIA H100をNVIDIA NVLinkで接続することにより、188GBの大容量GPUメモリと、メモリバンド幅 7.8 TB/s の高速なデータ転送を実現!

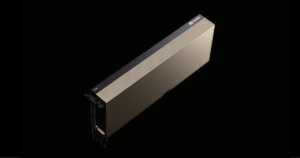

NVIDIA H100 80GB

NVIDIA H100 GPUは、GPUアーキテクチャ「Hopper」を採用し、80GB HBM2eの大容量GPUメモリ、第4世代のTensorコア、前世代となるNVIDIA A100 GPUの約1.5倍にあたる800億個のトランジスタが搭載されています。

NVIDIA A100 80GB

NVIDIA A100 GPUは、Ampereアーキテクチャ採用、GPUメモリ80GB、メモリ帯域幅2TB/s!単精度・倍精度演算性能を兼ね備え、NVIDIA A100 GPU は前世代と比較して最大20倍のパフォーマンス。

NVIDIA L40S

NVIDIA L40S GPUは142基の第3世代RTコア、GPUメモリは48GB GDDR6を搭載、第4世代TensorコアとTransformer Engine、新しい半精度性能(FP8)により、NVIDIA A100 GPUの推論性能を最大1.5倍上回ります。

NVIDIA L40

NVIDIA L40は、NVIDIA Ada Lovelaceアーキテクチャを採用し、前世代のNVIDIA A40 GPUと同じGPUメモリ容量 48GB GDDR6を搭載しており、NVIDIA L40は、A40 GPUの2倍の性能向上を実現。

NVIDIA A800 40GB Active

NVIDIA A800 GPUは倍精度ユーザーのためのワークステーション向けGPU。NVIDIA A800 GPUはGPUメモリ40GB、第3世代 Tensorコア、マルチインスタンスGPU搭載。AI、HPC、CAE、エンジニアリングシミュレーション(数値流体力学、構造解析など)のワークロードを加速します。

NVIDIA RTX シリーズ スペック比較

NVIDIA RTX PRO Blackwellと前世代Adaシリーズをスペック比較。生成AI・LLM、3D制作など業務用途に最適なGPU選定を支援します。

NVIDIA RTX PRO Blackwellシリーズ

NVIDIA RTX PRO Blackwellシリーズの特長とモデル別ラインナップを解説。RTX PRO 6000/6000 Max-Qなど業務用途向け次世代GPUの選定を支援します。

NVIDIA RTX PRO 6000 Blackwell Server Edition

NVIDIA RTX PRO 6000 Blackwell Server EditionでオンプレミスAI推論基盤を構築。生成AI・LLM・AIエージェント推論をサーバーに集約し、GPU共有や仮想化運用に対応します。