[No.106]米国連邦議会はAI規制法に向けた準備を開始、ホワイトハウスは信頼できるAIを開発するための研究所を設立

米国政府は危険なAIから国民を守る政策を相次いで発表した。

連邦議会はAIを安全に運用するための構想を明らかにした。

国民の権利を守るため、開発企業にAIシステムの内部を公開し、責任ある運用を求める。

また、ホワイトハウスは、信頼できるAIの開発に向けた政策を発表した。

全米に7つの研究所を設立し、AIの安全性を含む先進技法を開発する。

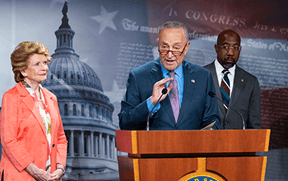

更に、ハリス副大統領は、GoogleやMicrosoftなどのCEOと会談し、AIの安全性を強化することを要請した(下の写真)。

米国政府の動き

米国政府がAI規制に向けて動き始めたが、その背景にはChatGPTなど生成AIの急速な普及がある。

アメリカ国民はAIの利便性だけでなく、その脅威を実感し、政府に安全対策を求めている。

また、中国政府がAI規制を導入したが、これが警鐘となり、米国もAIの倫理的な運用を実行し、テクノロジーにおける指導的立場を維持すべきとの世論が優勢になってきた。

連邦議会のAI規制法案

これに応えるかたちで、上院院内総務であるチャック・シューマー(Chuck Schumer、下の写真)はAI規制のフレームワークを発表した。

このフレームワークは四つのガードレールで構成され、AI開発企業に責任ある運用を求めている。

具体的には、AI開発企業は製品を出荷する前に、独立機関でAIの検査を受け、その結果を一般に公開することを求めている。

四つのガードレールはAIの透明性を求めるもので、その概要は:

- Who:誰がAIのアルゴリズムを教育したのかを開示する。誰がAIの利用者であるかを明らかにする。

- Where:教育で使ったデータはどこから来たのかその出典を開示する。

- How:アルゴリズムがどのように判定を下したのかそのメカニズムを明らかにする。

- Protect:AIがアメリカ国民の価値に沿っていることを保証する。

フレームワークの特徴

フレームワークは、AIシステムの内部を明らかにすることが、信頼できるAIに繋がると考える。

これにより、AIを誤用することを防ぎ、また、AIが偽情報を生成し、アルゴリズムがバイアスする危険性を低減する。

連邦議会はAIの透明性を担保することで、安全で信頼できるAIにつながるとの考え方を取る。

この法案骨子は、今後数週間にわたり、大学や民間や政府関係者の意見を聞き、最終調整された後に、議会で審議されることとなる。

バイデン政権のAI政策

今週、ホワイトハウスは信頼できるAIを開発するための新たな政策を発表した。

バイデン政権は国民から信頼されるAIを開発するために1億4000万ドルの予算を充て、全米に7つのAI研究所を設立する。

このプロジェクトは「National AI Research (NAIR) Institutes」と呼ばれ、アメリカ国立科学財団(National Science Foundation, NSF)が指揮をとる。

研究所はニューロサイエンスなど幅広い分野をカバーするが、その中心が信頼できるAI技法の開発となる。

AIの安全性の検証

また、ホワイトハウスはAI企業が製品を出荷する前にその安全性を保障することを要請している。

これを受け、GoogleやMicrosoftやNvidiaなどは、大規模言語モデルを公開の場で検証し、その安全性を確認するプロジェクトを計画している。

これは「Red Teaming」と呼ばれ、利用者がAIモデルを攻撃し、その脆弱性を把握する手法を取る。

更に、政策面では、アメリカ合衆国行政管理予算局(Office of Management and Budget)がこの夏までに、連邦政府がAIを安全に利用するためのガイドラインを策定する。

米国政府はAI規制に向かう

ヨーロッパ諸国は域内のAIを統一的に規制する法律「AI Act」の最終調整を進めている。

米国はAI規制で後れを取ってきたが、今年に入りAI規制を導入する動き急進し、バイデン政権や連邦議会が一斉に動き出した。

バイデン政権は、昨年は「チップ法」で半導体製造を国産化するための法律を可決した。

今年は、AIの研究開発を支援する観点から、国民に信頼されるAIの普及を目指す。

連邦議会は、中国政府に対峙し、国家安全保障を担保する観点から、AI規制を進める。