[No.96]AIが生成するメディアで社会が混乱、米国と欧州で「生成型AI(Generative AI)」の規制が始まる

ネット上にAIで生成した写真や記事が満ち溢れ、人間が生成したコンテンツと見分けがつかず、何が真実か判別できず、社会が大混乱している。

ChatGPTは人間のように対話するチャットボットであるが、これを悪用してソーシャルメディアで偽情報を拡散する危険性が指摘される。

米国と欧州で、生成型AI(Generative AI)を安全に運用するためのルールが制定された。

米国では非営利団体「Partnership on AI」が、生成型AIの開発や運用に関するフレームワークを公開した。

欧州ではAI規制法「AI Act」に生成型AIを追加するための準備が進んでいる。

生成型AIとは

メディアを生成するAIは「生成型AI(Generative AI)」と呼ばれ、人間のようにテキストやイメージを生成する。

OpenAIが開発した「ChatGPT」は高度な言語能力を持ち、人間の記者に代わり記事を執筆し、読者を混乱させた。

Stability AIが開発した「Stable Diffusion」は言葉の指示でリアルな画像を生成するが、セレブのヌード写真など不適切なイメージがネットで拡散している。

Partnership on AI

このため、AIの非営利団体Partnership on AIが中心となり、生成型AIが生み出すメディアを安全に利用するためのガイドラインを設立した(上の写真)。

同団体の会員10社がこれに賛同し、AIの開発や運用で、このガイドラインに準拠して、倫理的にAIを開発・運用することを表明した。

参加企業10社は、AIを開発するグループと、AIを利用するグループに分けられ、主な企業は次の通り。

- AI開発企業:Adobe、OpenAI、Synthesia、TikTok

- AI運用企業:BBC、Bumble、CBC Radio Canada

AI開発企業はOpenAIなどで高度な生成型AIを生み出し、AI運用企業はBBCなどで、AIで生成したメディアを配信する。

ガイドラインの要旨

ガイドラインの骨子は、消費者に、どれがAIで生成したメディアかを知らしめることにある。

AIは、人間レベルの文章を生成し、芸術家の技量を上回るアートを生成する。

ネット上にはAIが生成したメディアが満ち溢れ、どれが人間が生成したもので、どれがAIが生成したものか判断がつかない状態となっている。

ガイドラインは、AIが生成したメディアに特殊なデータを挿入し、また、それをトレースできる機構を追加することを推奨する。

AI開発企業向けのガイドライン

具体的には、メディアを生み出すAIを開発する企業が取るべき手法と、生み出されたメディアを利用して事業を展開する手法が規定されている。

AI開発企業は、メディアを生成する手法と、それを配信する手法を公開することが求められる。

技術的な手法としては、次の方法を推奨している。

- ラベル:AIが生成したメディアにその旨のラベルを付加する。文章による説明文やウォーターマークなどを付加する。(下の写真、Synthesiaで生成したビデオに「このアバターはAIで生成したもの」とのラベルを添付。)

- データ:メディアがAIで生成されたことを示すメタデータ。AIの教育データの出典をトレースできる機能。メディアを格納するファイルのメタデータなど。

AI配信企業向けのガイドライン

生み出されたメディアを利用して事業を展開する企業に対しても、ガイドラインはベストプラクティスを規定している。

二つのカテゴリから成り:

- メディアのクリエーター:視聴者にAIメディアを生成する過程を開示。メディア関係者の許諾を得たことなどを開示する。

- メディアの配信企業:Facebookなどソーシャルメディアは配信するコンテンツがAIで生成された旨を表示。社会に害悪を与えるAIメディアの配信を停止するなど。

米国における初の試み

米国においてはAIメディアに関する規制は無く、高度なAIが悪用され、危険性が広がっている。

Partnership on AIのガイドラインが初の試みで、AI開発会社やソーシャルメディアなど配信会社は、この規定に準拠して生成型AIを倫理的に開発し、安全に運用する。

一方、ガイドラインは政府が定める法令ではなく、企業が任意で導入するもので、その成果を疑問視する声もある。

欧州連合のAI規制法

これに対し欧州連合(European Union)は、AIの運用を規制する法案「AI Act」の設立に向け最終調整を進めている。

AIは社会に多大な恩恵をもたらすが、その危険性も重大で、EUは世界に先駆けてAIの規制に踏み出す。

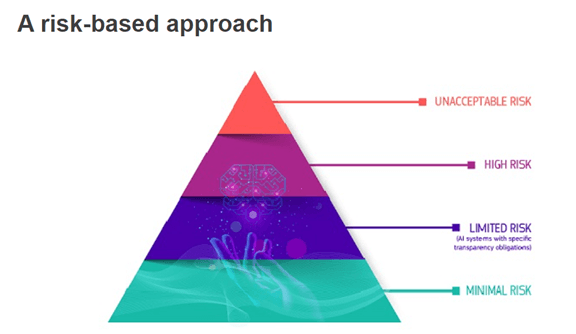

欧州委員会はAIの危険度を四段階に分けて定義し(下の写真)、それぞれの利用法を規定している。

違反への制裁金は最大で3000万ユーロか、全世界の売上高の6%のうち高い金額となり、法令への準拠が必須となる。

現在、企業などから寄せられたパブリックコメントをもとに、法案のアップデート作業が進められ、2023年後半に成立すると予測されている。

「General Purpose AI」を追加

EUはAI Actに生成型AIを加える方向で準備を進めている。EUはこのモデルを「General Purpose AI」と呼び、汎用的に使えるAIを法令に加える。

General Purpose AIは、大規模AIモデルで、基本モデルを改造することなく、複数の目的に使えるアルゴリズムを意味する。

米国では「Foundation Model」とも呼ばれ、大規模言語モデルがこれに該当する。

例えば、Transformerで構成されるGPT-3は人間のように高度な文章を生成する。

また、GPT-3.5はChatGPTのようにチャットボットを支える基礎技術となる。

AI ActはGPT-3など大規模言語モデルを規制する方向で最終調整を進めている。

米国と欧州で規制が進む

米国は生成型AIの開発と運用のガイドラインを制定し、業界団体が自主的に安全な利用法を導入する。

一方、欧州は法令として制定し、AI企業はこれに準拠することが義務付けられる。

米国と欧州で規制の方式は異なるが、生成型AIの危険性が認識され、これを安全に運用することが社会の責務となっている。

特に、米国では、OpenAIなどが高度な生成型AIを生み出しており、国民世論はAIの安全性を強化するよう求めている。