[No.92]Amazonは「ChatGPT」の使用を禁止、チャットボットが会社の機密情報をリークする

OpenAIが開発したチャットボット「ChatGPT」は高度な言語能力を持ち、米国で利用が急拡大している。特に、企業の社員は日常業務でChatGPTを利用し、仕事の効率を上げている。

社員は、業務資料の制作やプログラミングで、ChatGPTを使っている。

企業内で利用が広がる中、Amazonは社員がChatGPTを利用することを禁止した。

チャットボットが会社の機密情報をリークする危険性が明らかになったためである。

チャットボットの危険性

AmazonはChatGPTが出力するデータに会社の機密情報が含まれていると指摘する。

社員がChatGPTに機密情報を入力し、これをアルゴリズムが学習し、その情報が社内に漏れることを懸念している。

社員はChatGPTに機密情報を入力し、そのアップデートや修正をリクエストする。

その際に、アルゴリズムは機密情報を学習し、ChatGPTが改版される。

改版されたChatGPTに、社外の利用者が質問を入力すると、アルゴリズムは学習した機密情報を出力する危険性がある。

Amazon社内でのChatGPTの利用法

Amazonの社員がChatGPTを使って業務を遂行している実態が明らかになった。

社員はChatGPTをプログラムのコーディングを支援するツールとして使っている。

コーディングにおいて、社員はChatGPTでプログラムをデバッグし、また、ロジックを改良する。

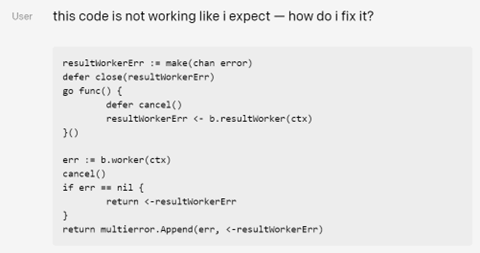

社員は開発中のコードをChatGPTに入力し、チャットボットにこれを効率化するよう指示する(下の写真、ChatGPTにコードのデバッグを指示したケース)。

ChatGPTはこれに従ってコードを生成するが、アルゴリズムは入力されたコードを学習し、これを社外の利用者に出力する危険性がある。

特に、コードが開発中の先進技術を含んでいれば、情報がリークした際の被害は甚大となる。

AmazonはChatGPTの利用を禁止

このため、Amazonは社員が会社支給のデバイスでChatGPTを使うことを禁止した。

社員がこれらデバイスでChatGPTのサイトにアクセスすると、警告メッセージを表示し、セキュリティの問題があることを説明する。

しかし、社員としては、ChatGPTを使うと仕事がはかどるので、会社が使用を禁止するものの、継続して使われているのが実態である。

AmazonはChatGPTに対抗するAIモデル「CodeWhisperer」を開発し、これをクラウドで提供している。

これはコーディング支援ツールで、アルゴリズムがプログラマの指示に従ってプログラムを生成する。社員は自社製品ではなくChatGPTを利用している。

AmazonはChatGPTの導入を検討

一方、AmazonはChatGPTをクラウド事業に導入することを検討している。

Amazon Web Services(AWS)のサポート部門は、ChatGPTをサポートセンターに導入し、顧客向けの技術支援をチャットボットで実行する構想を描いている。

顧客はAWSで問題が発生すると、サポートセンターにコンタクトし、技術支援を仰ぐ。

この際に、エンジニアに代わりChatGPTが顧客と対話して、トラブルシューティングを実行する。

現在、ChatGPTの機能を検証しているところであるが、結果は良好であるとしている。

ChatGPTの教育方法が不透明

ChatGPTの利用が急拡大しているが、OpenAIはアルゴリズムを教育するメカニズムを公開しておらず、社会に不安が広がっている。

ChatGPTに入力したデータがどのように使われ、それが他の利用者にどのように出力されるのか、そのメカニズムが公開されていない。

OpenAIは、大量のデータでChatGPTの言語モデル「GPT-3.5」を教育したことは分かっているが、その後、チャットボットの運用を開始してからは、利用者が入力するデータでアルゴリズムの教育が進むと推測される。

このため、入力した機密情報がアルゴリズム教育で使われ、学習したデータが他の場所で出力する危険性が指摘される。

実際に、OpenAIはChatGPTの利用規約の中で、利用者が入力するデータをアルゴリズム教育で使うことの許諾を求める条項がある(下の写真、シェイドの部分)。

ChatGPTの危険性を理解して活用

ChatGPTは仕事の効率をアップするための優れたツールであるが、同時に、機密情報をリークする危険性があることが分かってきた。

このため、企業はChatGPTを評価し、社内で安全に運用するためのガイドラインを策定することが必須となる。

また、個人でChatGPTを利用する際は、個人の機密情報を入力することは危険である。

氏名、住所、電話番号、クレジットカード番号、暗証番号などを入力すると、これが他の利用者にリークする危険性は大きい。

会社と個人はChatGPTの危険性を理解して安全に活用する必要がある。