[No.50] NVIDIAは2D写真をAIで繋げ3Dモデルを高速で生成する技法を開発、メタバースやアバターの生成に適用

NVIDIAは開発者会議「GTC 2022」をオンラインで開催した。

分科会でAI研究の最新成果として、3Dモデルを高速で生成する技法を発表した。

これは「Instant NeRF」と呼ばれ、カメラで撮影した複数の写真をAIで繋げ、3D世界を構築する技法である。

オブジェクトや人の3Dモデルを簡単に生成できるため、メタバースを構築する基礎技術として期待されている。

3Dモデルを生成する技術

撮影した写真を張り合わせ、被写体の3Dモデルを生成する技術は数多く存在し、ビジネスなどで利用されている。

一般に、3Dモデルを生成するためには、奥行きを計測できるカメラ「Depth Camera」を使い、被写体を撮影し、それを立体的に張り合わせ、3Dモデルを生成する。

また、自動運転車はLidarを使って道路や市街地の3Dモデルを作成し、この3Dマップに従って安全に走行する。

NeRFという技法

これに対し、Neural Radiance Fields(NeRF)は、カメラで撮影した写真をAIで繋ぎ合わせ、3Dモデルを生成する。

2D写真をAIで3Dに再構築するため、簡単に立体モデルを生成でき、それを柔軟に操作できる。

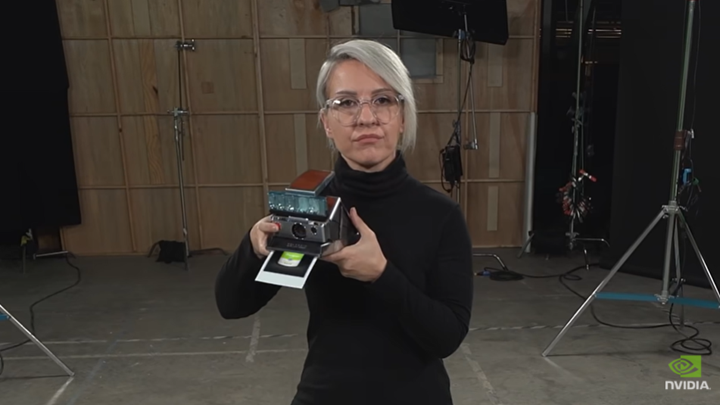

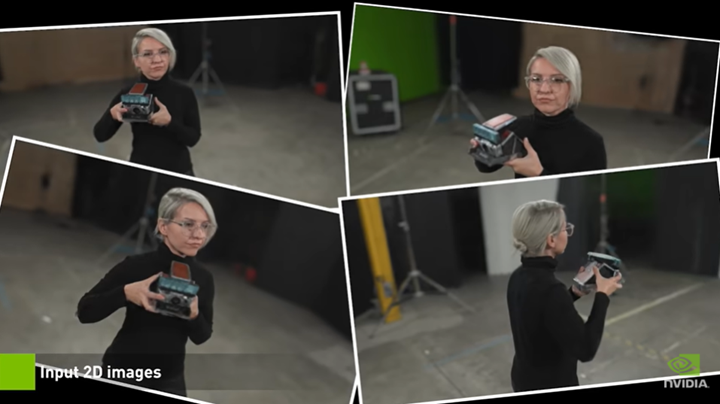

具体的には、カメラで被写体を異なる位置から撮影し(下の写真)、撮影された写真をニューラルネットワークに入力し、被写体を3Dで描写する(先頭の写真)。

3Dモデルが完成すると、被写体の周囲を自由に移動でき、異なるアングルから見ることができる。

NVIDIAは高速でNeRFを生成する技術「Instant NeRF」を開発し、そのビデオを公開している。(ビデオへのリンク)。

NeRFのコンセプト

NeRFを使うとオブジェクトを簡単に3D化することができる。

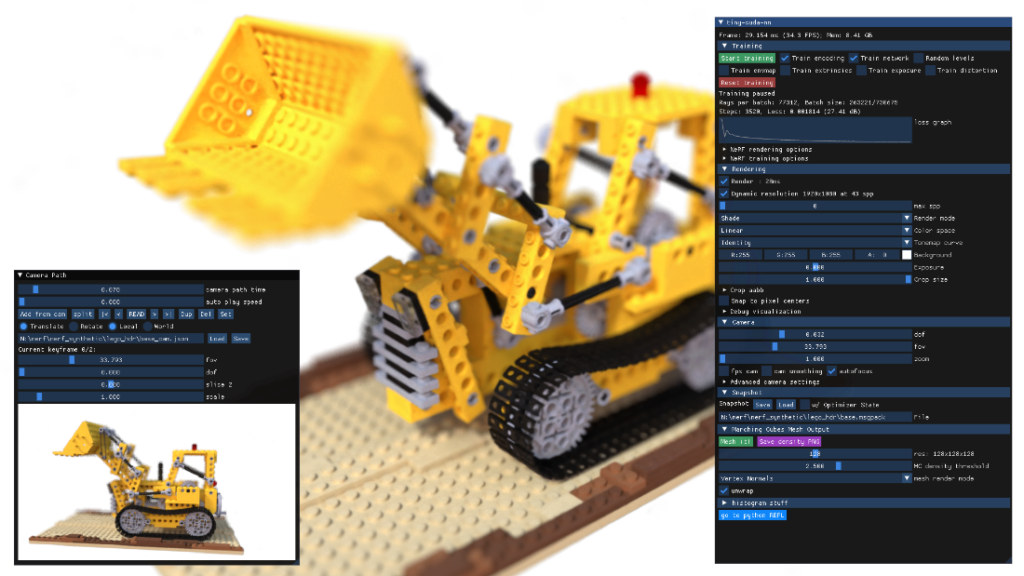

例えば、レゴで組み立てたブルドーザーを異なるアングルから撮影し、それをNeRFで処理すると、その3Dモデルが生成される(下の写真)。

スマホカメラで写真を撮ると2DイメージがJPEGに圧縮されるように、複数の写真をNeRFで圧縮すると、3Dモデルが生成される。NeRFは「3Dカメラ」の基礎技術と位置付けられる。

NeRFの利用方法

NeRFの利用法は様々であるが、メタバースの基礎技術として注目されている。

NVIDIAはオブジェクトや人のデジタルツインを生成し、メタバースでそれをシミュレーションする手法を取る。

その際に、オブジェクトの3DモデルをNeRFで生成する。

また人のデジタルツインとなるアバターをNeRFで生成する。(下の写真、Instant NeRFで生成された制御室、3Dモデルの解像度は高く、また、ケーブルの陰になっている部分も正確に描写されている。)

NeRFの仕組み

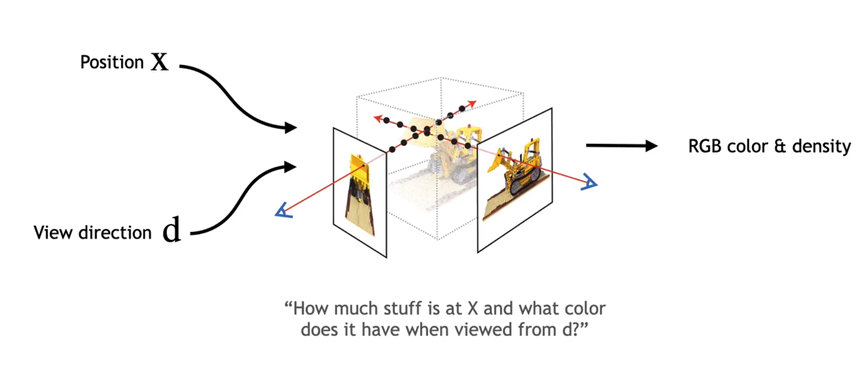

NeRFは異なるアングルから撮影した写真を入力とし、それらを色と形状に変換するニューラルネットワークとなる(下のグラフィックス)。

実際には、写真を撮影した位置(Position、(x, y, z))と視線(View Angle、(θ, Φ))を入力し、ニューラルネットワークは色(RGB)と密度(Density、σ)を出力する。

ニューラルネットワークを複数の写真で教育し、完成したNeRFに見る方向を入力すると、そのイメージを出力する。

つまり、オブジェクトを周囲から見渡せるようになる。

Instant NeRF

NVIDIAはNeRFの高速版である「Instant NeRF」を開発した。入力するデータを前処理することで、従来のNeRFに比べ1,000倍高速で処理できる。

例えば、オブジェクトを撮影した写真40枚程度でニューラルネットワークを教育すると、その処理時間は数秒程度となる。

また、完成したInstant NeRFで3Dイメージを生成するにはミリセカンドで実行できる。

ほぼリアルタイムで3Dモデルを生成できるようになり、応用分野が大きく広がると期待される。(下の写真、レゴのブルドーザーの写真でInstant NeRFを教育し3Dモデルを生成。)

3Dモデルの普及

NVIDIAによると、75年前にポラロイドカメラ(Polaroid Camera)が開発され、3Dモデルを瞬時に2Dの写真に変換することに成功した。

Instant NeRFは逆のプロセスで、2Dの写真から瞬時に3Dモデルを生成する。

ポラロイドカメラが写真が普及する礎を築いたように、NeRFにより3Dモデルが普及すると期待されている。