[No.171]EUのAI規制法「AI Act」が発効、OpenAIなど生成AI開発企業は法令準拠の準備を加速、米国企業へのインパクトが甚大、生成AIを組み込んだシステムを開発する企業も対象となり注意を要す

EUのAI規制法「AI Act」が8月1日に発効した。

AI Actは最終段階で生成AIに関する規定を追加し、OpenAIなど米国企業は法令に準拠する準備作業を加速している。AI Actは生成AIを利用する下流企業についても規定しており、生成AIを統合したAIシステムも規制の対象となる。

EUに拠点を置く企業だけでなく、EU域内にAIシステムを展開する企業も規定の対象となる。

日本企業が生成AIを統合したAIシステムをEU内で展開する場合も、AI Actの規定に準拠することが求められる。

AI Actの概要

AI Actは欧州連合(European Union、EU)が制定した法令で、欧州でAIを安全に開発・運用・利用するためのフレームワークとなる。2020年から審議が始まり、5年の歳月を経て、今年5月に法令が成立し、先週8月1日に発効した。

EU域内にAIシステムを供給する企業はこの法令の対象となる。

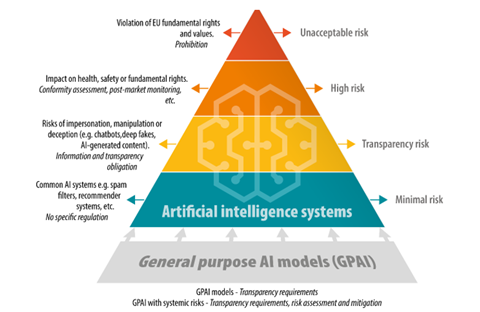

AIのリスクと規定

AI ActはEU内でAIを安全に開発・運用・利用するためのフレームワークで、AIシステム「AI Systems」のリスクの程度に応じた管理を定義している。

これは、「Risk-based Approach」と呼ばれ、AIシステムの危険度を四段階に分けし、それぞれの規定が定められている。また、最終段階で生成AIが追加され、汎用AIとして定義された(下の写真)。

それぞれの項目は:

- 危険なAI (Unacceptable Risk AI):使用禁止、顔認証技術による住民監視など

- ハイリスクAI(High-risk AI):規定された対策を適用し使用、人事採用での判定や社員のモニターなど

- ローリスクAI(Limited Risk AI):表示義務を条件に使用可、チャットボットなど

- ミニマムリスクAI (Minimal Risk AI):無条件で利用可、スパムフィルターなど

- 生成AI(General-Purpose AI):モデル情報開示など特別な規定、生成AIを組み込んだAIシステムは上記の条件が適用される

これらの規定に違反するとAIシステムのリスクレベルに応じて制裁金が課され、危険なAIのケースでは、3500万ユーロか売上高の7%となる。

AI Actの特徴はAIの危険度を定義し、それに応じた運用条件を定めたことにある。

生成AIに関する規定

生成AIは「General-Purpose AI (GPAI)、汎用AI」と呼ばれ、安全に運用するための規定が制定された。

生成AIは幅広いタスクに適用されるため「汎用AI」として定義され、その開発や運用においてモデルの情報を開示することが義務付けられた。

具体的には:

- AIモデルに関する技術ドキュメントを生成しAIオフィスに提出

- 生成AIでAIシステムを開発する企業向けに技術資料を提供

- EUの著作権に準拠するための指針を作成

- 生成AIを教育する際に使用したコンテンツのサマリーを提供

大規模な生成AIに関する規定

AI Actは大規模な生成AIに関して追加の規制条項を設けている。

生成AIの機能を教育で使われたコンピュータの規模で定義しており、10^25(10の25乗) FLOPsの性能を超える計算機で開発されたモデルはこの規定に従うことが求められる。

具体的には、Open AIのGPT-4oやGoogleのGeminiがこれに該当し、開発企業は下記の規定に準拠した対応が求められる:

- システムに内在するリスクを特定するための検査を実施、また、継続的にリスクを評価し危険性を低減

- 大規模な生成AIに該当する場合はEU Commissionに通知

- 重大なインシデントをモニターしそれを報告

- モデルのサイバーセキュリティ機能を強化、また、物理的なインフラの強化

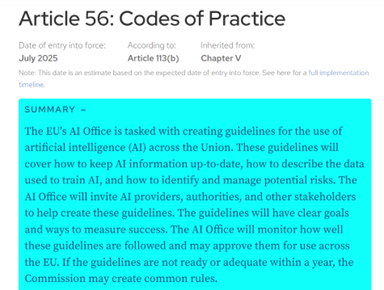

生成AIが準拠すべき条件については「Codes of Practice」に記載されている(下の写真)。

一方、この規定についてはまだ検討が続いており、一般からのコメントを参考に、2025年5月に最終決定される。

今後のタイムライン

AI ActはAIシステムのリスクの度合いに応じて規定が発効する時期を設定している。

危険度が高いAIシステムから規定が発効するアプローチとなる。また、生成AIについては、一年後の2025年8月から適用が開始される。

AI Actが発効するタイムラインは:

2024年8月:AI Actが発効

2025年2月:危険なAI (Unacceptable Risk AI)の使用禁止

2025年5月:Codes of Practice(生成AIに関する運用規定)決定

2025年8月:生成AI(General-Purpose AI)に関する条項が発効

2026年8月:ハイリスクAI(High-risk AI)に関する規制が発効

上述の通り、生成AIに関する規定は「Codes of Practice」で定められるが、まだ検討が続いており、2025年5月に最終決定される。

AI Actの対象となる企業

AI Actは生成AIを開発している企業だけでなく、それを組み込んで「AIシステム」を構築している企業も対象になるので注意を要す。

国籍に関してはEU企業だけでなく、域外の企業であってもEUにAIシステムを納入している企業は規制の対象となる。具体的には、生成AIを開発しているOpenAIだけでなく、GPT-4を組み込んだAIシステムを開発している企業も対象となる。

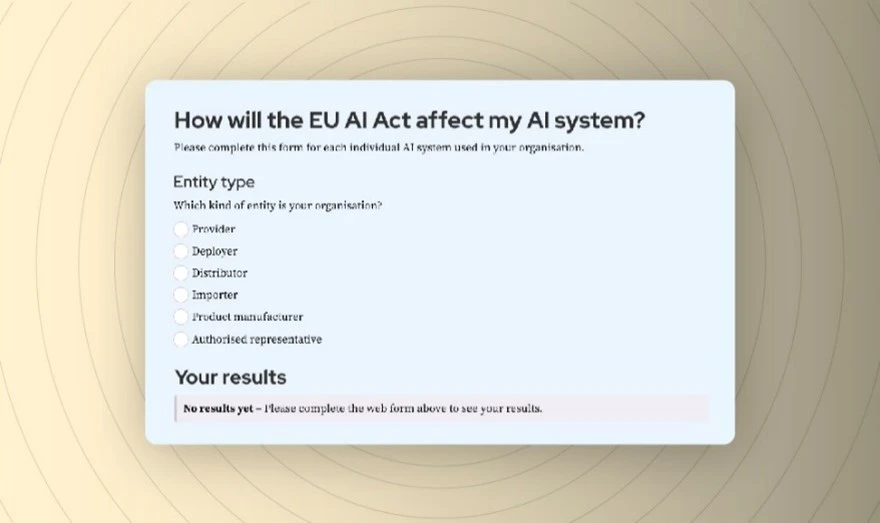

AI Actはこれらの企業を「AIプロバイダー」と「AIディプロイヤー」と定義している:

- AIディプロイヤー(AI Deployer):AIシステムや生成AIを組み込んだシステムを開発している企業、AI開発企業やインテグレータなど

- AIプロバイダー(AI Provider):AIシステムや生成AIを開発している企業、OpenAIやGoogleなど

AI企業は、EUが公開しているツール「EU AI Act Compliance Checker」(上の写真)を使い、自社がどのカテゴリーに区分されるのかを把握し、それに応じた対応を取ることを推奨している。

AI開発企業やインテグレータ

AI ActはOpenAIのように生成AIモデルを提供する企業(AI Provider)だけでなく、生成AIを使ってAIシステムを開発している企業(AI Deployer)も対象としているので注意を要す。

後者は、生成AIを自社ブランドで販売しているケースや、生成AIを改造して販売しているケースなどで、AI Actが定める規定に準拠することになる。

米国企業へのインパクト

バイデン政権は生成AIを安全に展開するため、法令ではなく大統領令で企業に自主規制を求めている。

対象となる生成AIは10^26 FLOPsの性能を超える計算機で開発されたモデルで、現行製品はこの規制から外れ、次世代モデル(OpenAI GPT-5など)から規定が適用される。AI Actは現行の生成AIモデルが対象となり、法令適用の範囲が広い。

生成AI開発企業の殆どが米国企業で、法令のインパクトは欧州より米国のほうが大きい。

日本企業へのインパクト

日本企業がOpenAIのGPT-4やGoogleのGeminiを組み込んだAIシステムを構築し、それをEU内の顧客に納入しているケースでは、AI Actの規制が適用されるので注意を要す。

企業は、AIシステムの特性を評価し、これがどのレベルのリスクになるのかを査定し、それに基づいた対応が求められる。

生成AIに関する規約が発効するのは1年後で、準備期間が限られており、迅速な対応が必要になる。