[No.170]バイデン政権AI大統領令の進捗状況:AppleはAIの安全性を自主規制することを確約、米国商務省は生成AIを安全に運用するためのガイドラインを公開、ハリス政権が誕生する機運が高まり大統領令は継続される方向へ

バイデン大統領は昨年10月、AIの安全性に関する大統領令に署名し、米国企業に責任あるAI開発を求めた。

15社がこの規約に準拠することを確約しているが、新たにAppleが加わり、米国の主要企業は責任あるAI開発で足並みがそろった。今週、ホワイトハウスは大統領令で規定されたアクション項目の進展状況を公開し、予定通り目標が達成されていることをアピールした。

大統領令は法令ではなく、政権が変わるとその機能が停止される可能性があり、米国のAI政策は先が見通せない状況が続いていた。

しかし、カマラ・ハリス大統領候補の人気が急上昇し、ハリス政権が誕生する可能性が濃厚となり、大統領令は継続して運用される公算が高まった。

AIに関する大統領令とは

バイデン大統領は2023年10月、責任あるAI開発と技術革新を推進するため、大統領令「President’s Executive Order on Safe, Secure, and Trustworthy Artificial Intelligence (14110)」に署名した(下の写真)。

大統領令は国家安全保障と国民の権利を守る観点から、AIが危害を及ぼさないようセーフガードを設け、また、生物兵器の開発やサイバー攻撃を防ぐための機構を導入することを規定している。

AI開発企業の同意

AI開発企業には、大規模モデル(Foundation Models)の安全試験を実施し、その結果を報告することを求めている。

これは開発企業の自主的なコミットメント「Volunteer Commitment」に基づくもので、法令ではなく自主規制を尊重するポジションを取る。自主規制にはGoogleやOpenAIなど主要企業が参加しているが、ここにAppleが加わり、米国の主要企業が大統領令に従って安全なモデルを開発する。

大統領令の制作ではハリス副大統領(右側の人物)が重要な役割を担い、米国政府の”AI司令官”と呼ばれている。

大統領令の実施状況

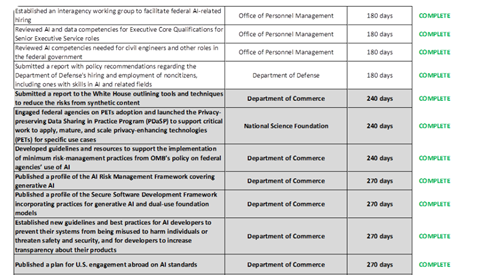

大統領令は連邦省庁に対してAIの導入や運用に関して広範なアクションを定めており、ホワイトハウスはこの達成状況を公開した。

大統領令にはAIの運用に関し、実施項目(Action)と責任組織(Agency)と完了日(Required Timeline)が定められており、各省庁はこのアクションプランに沿って、規定された項目を期日までに完了すべく作業を進めてきた。

ホワイトハウスは、270日以内に完了する項目について、全て予定通り達成できたと発表した。(下のテーブル、一部、シェイドの部分が今回達成したアクション項目)

アメリカ商務省の役割

責任あるAI開発ではアメリカ商務省(U.S. Department of Commerce、下の写真)がハブ機関となり、フレームワークやガイドラインを制定している。

実際には、商務省配下のアメリカ国立標準技術研究所(National Institute of Standards and Technology、NIST)が実働部門として重要な役割を担っている。更に、NIST配下に新設されたAI安全推進室「U.S. AI Safety Institute」が大規模モデル(Foundation Models)を安全に運用するための指令室となる。

AI開発企業はAI安全推進室と密接に連携し、次世代モデルの安全試験を実行する。実際に、AI安全推進室はOpenAIと共同で、次世代モデル(GPT-5)に関する安全試験のプロセスを進めている。

AI安全推進室:モデルが悪用される危険性を防ぐ指針

AI安全推進室はNISTの配下の組織で、大統領令の発効に伴って設立され、科学技術を基盤とするAIの安全性(AI Safety)を推進することをミッションとする。

AI安全推進室は大規模モデルが悪用されることを防ぐためのガイドラインを公開した(下の写真)。大規模モデルは社会に役立つ高度な機能を持つが、同時に、これが悪用されると社会に重大な危険性をもたらす。

ガイドラインは、大規模モデルが悪用されることを防ぐための手順を提案している。

危険性は二種類に分類され:

- 現行のリスク:危険情報、ヘイトスピーチ、同意を得ないヌードイメージの生成など

- 将来のリスク:大規模モデルによる生物兵器の開発やサイバー攻撃など

について規定している。ガイドラインは発生が予想されるリスクを説明し、これら抑止するための手順を示している。

このドキュメントはドラフトとして公開され、パブリックコメントを反映し、ガイドライン最終版を開発する。

NIST:責任ある生成AIを開発するためのフレームワーク

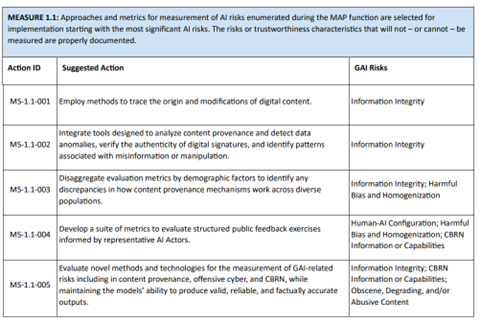

NISTは生成AIのリスクを管理すためのフレームワーク「The AI RMF Generative AI Profile」を公開した。

このドキュメントは開発企業が生成AIを安全に開発運用するためのフレームワークで、AIのリスクを特定し、その対応策をライフサイクルにわたって提唱している。開発企業はこのフレームワークに従って、モデルを設計、開発、運用、監査することで、生成AIのリスクを低減する。

このフレームワークは生成AIを包括的にカバーしており、12のリスクを特定し、それに対する200のアクションを示している。フレームワークはこれらのリスクを特定する手法や、リスクに対処するための手法を規定している。(下の写真、リスクを査定する手法とリスクを軽減するためのアクションを示している。

デジタル・コンテンツに関しては、出典や改造をトレースするための手法を導入することを推奨。)

トランプ政権かハリス政権か

大統領令は責任あるAI開発と運用を求めており、アクション項目は多岐にわたる。

米国の主要開発企業はこの規定に沿って、安全なAIを開発することをコミットしている。また、連邦政府は社会のモデルケースとして、AIを安全に導入し運用するためのベストプラクティスを実行している。

トランプ政権が誕生すると、この大統領令が停止され、これらの規定が効力を失うと危惧されてきた。しかし、ハリス政権が誕生する機運が急速に高まり、大統領令が継続される公算が高まった。

まだ、大統領選挙の結果を予想することは難しく、シリコンバレーはトランプ政権とハリス政権の二つのケースに対処できるよう準備を進めている。