[No.154]アメリカ政府と欧州連合はハイテク技術に関する共同声明を発表、AIや量子コンピュータや6Gの開発で世界をリードすることを宣言

アメリカ政府と欧州連合は4月5日、通商とテクノロジーに関し共同声明を発表した。

両者はAIや量子コンピュータや6Gなど先端技術の開発を促進し、世界をリードすることを宣言した。AIに関しては安全なモデルを開発するために、リスクベースのアプローチを取ることを再確認した。

更に、両者のAIセーフティ部門間に対話のチャネルを設け、情報交換などを促進することを決定した。

共同声明の背景

アメリカ政府と欧州連合(European Union、EU)は経済とテクノロジーの振興を目的に、通商技術委員会「EU-US Trade and Technology Council(TTC)」を設立している。

TTCはグローバルな経済圏の急変や先端技術の急伸など、環境の変化に対応し、両者間で経済・技術協力を進めるために設立された。特に、中国の技術進化を念頭に、両者で協調して経済や技術の成長を促進する。

技術分野では、AIや量子コンピュータや6Gなどを対象に、提携を深め技術開発を促進する。

共同声明の内容

共同声明はベルギーで開催された第六次TTC委員会「Sixth U.S.-EU Trade and Technology Council」(上の写真)で発表された。

米国国務長官Antony Blinken(左端の人物)らが共同議長を務めた。共同声明は経済と技術に関し、幅広い分野をカバーしているが、テクノロジーに関しては先進分野で市場をリードすることを宣言した。米国側はホワイトハウスが共同声明をリリースした(下の写真)。

テクノロジーに関する声明の概要は:

- AI:リスクベースの方式でAIモデルを開発することを再確認。両者間で対話のチャネルを開設し情報交換

- 量子コンピュータ:タスクフォースを開設し科学技術開発で協調

- 6G:次世代無線通信技術に関する基礎研究を共同で展開

- 半導体:両者間で強靭な半導体供給網を設立

- バイオテクノロジー:メリットとリスクを理解して研究開発を推進

- 技術標準化:EV充電ステーションなど重要技術の標準化を推進

AIに関する安全技術

AIに関してはモデルを安全に開発運用するための様々な提言が盛り込まれた。

また、米国とEUは独自にAIの安全技術を開発しているが、共通の安全規格を制定することを提唱している。

AIに関する共同声明の概要:

- 安全で信頼できるAIを開発するためにリスクベースの手法を取る

- 安全性に関し多国間(G7, OECD, G20, Council of Europe, UN)で協調する

- 両者のAI安全組織(米国 = AI Safety InstituteとEU = European AI Office)の間で対話のチャネルを開設

- AIのリスクを査定・検証する技法の開発に関しロードマップを策定

リスクベースの手法とは

安全なAIモデルを開発運用するために、様々な手法が提唱されているが、「リスクベースの手法(Risk-based Approach)」が注目されている。

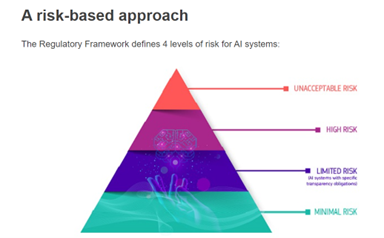

この手法は、AIの開発運用を統制する際に、AIモデルが個人や社会に及ぼす危険性を把握し、その度合いに応じて対処法を決めるメカニズムとなる。危険度が大きいAIモデルに対しては、その運用を厳しく規制するなどの処置を取る。

欧州連合の「AI規制法(AI Act)」がリスクベースの手法を導入しており(下の写真)、この方式が世界の主流になりつつある。

米国政府もリスクベースの手法でAIの開発運用に関するフレームワークを制定した。

AIのリスクを査定・検証する技法

米国とEUは、信頼できるAIを開発するために、リスクを管理する技法を独自に制定しているが、これを統合し共通のフレームワークを構築することに合意し、これに向かったロードマップを公開している。

ロードマップはAIの安全技術に関し、両者で共通の基盤を構築することに加え、国際標準規格を制定することを規定している。これに従って、両者はアクションプランを定め、これに向けた活動を展開している。

短期的には、ワーキンググループを設立し、用語を統一し、安全規格の検証などが規定されている。

米国とEUのAI規制の互換性

米国とEUはリスクベースの手法を採用することでは一致しているが、それを実施する方式では異なる規制を導入している。

EUはAI ActとしてAIを安全に開発運用することを法律で義務付けた。これに対し、米国政府はAIのリスク管理フレームワークを公開し、企業が自律的に安全対策を実行する。

共同声明は、AIのリスクを査定・検証する技法の開発に関しロードマップを策定することを提言しており、両者で共通の安全規格を制定する活動が進むと期待されている。