[No.108]米国連邦議会は生成AIに関する公聴会を開催、OpenAIはAIの販売にライセンス制度を導入することを提案

米国連邦議会上院は生成AIに関する公聴会を開催し、OpenAIのSam Altmanらが安全対策に関し意見を述べた。

その中で、Altmanは高度なAIを規制する必要があると述べ、連邦政府と協力する姿勢を明らかにした。

更に、企業は安全規格に従ってAIを開発し、AIの販売や運用にライセンス制度を導入することを提言した。

医薬品の開発では臨床試験により安全性が確認されるように、AIも審査をクリアしたものだけが販売を認められる制度の検討が始まった。

上院議会公聴会の概要

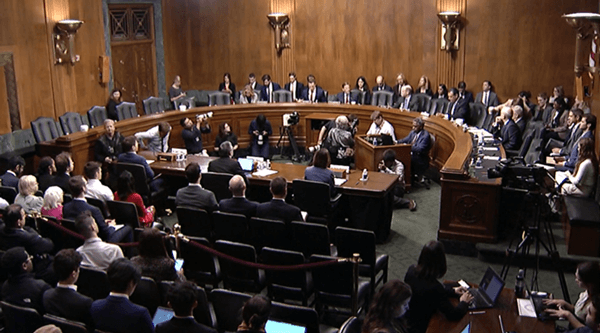

連邦議会上院の法務委員会「U.S. Senate Committee on the Judiciary Subcommittee」は、生成AIに関する公聴会を開催し、OpenAIのAltmanの他に、IBMの倫理AI責任者Christina Montgomeryとニューヨーク大学名誉教授Gary Marcusが証言した。

公聴会は高度なAIをどう規制するかについて議論された。

三者の発言の要旨は:

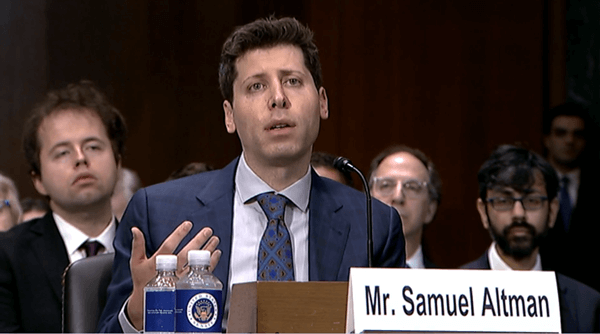

- Sam Altman:OpenAIの安全対策を説明。政府が安全なAIに関する基準を設け、企業はこれに従ってAIを開発・運用することを提言。(下の写真)

- Christina Montgomery:IBMは企業向けに、AIの危険性を低減し、安全なモデルを開発していることを説明。

- Gary Marcus:高度なAIは重大な危険性を内包し、社会に深刻な危険性を及ぼしていることを事例をあげて説明。

OpenAIの安全対策

AltmanはChatGPTやGPT-4が使われている事例を示し、生成AIは社会に多大な恩恵をもたらしていることを説明した。

また、OpenAIはAIの危険性を低減するために、様々な技法を開発し、モデルを出荷する前に、社内だけでなく、社外の専門企業に委託し、安全性の検証作業を実施した経緯を説明。

GPT-4のケースでは、アルゴリズムの教育が終わった後、六ヶ月にわたり、多角的に安全性の試験を実施した。

プライバシー侵害

多くの議員は、ChatGPTは個人のプライバシーを侵害していると重大な懸念を示した。

ChatGPTの開発では、ウェブサイトのデータがスクレ―ピングされ、個人情報や著作物がアルゴリズム教育で使われていることを指摘。

また、ChatGPTとの対話で入力された会話データがアルゴリズム教育で使われることにも懸念が示された。

プライバシー保護の対策と提案

これに対し、Altmanは個人のプライバシー保護を重要課題と位置付け、様々な対策を講じていることを説明した。

更に、議員の指摘に対し、新たな制度を導入する考えを示した:

- ターゲッティング広告:ChatGPTは個人データから消費者のプロフィールを構築し、これをターゲッティング広告などで使うことはない

- 対話データ:ChatGPTは利用者との会話データを使ってアルゴリズムを教育していることは事実。しかし、利用者は会話データの利用を禁止するオプションがあり、これを選択すると対話データは破棄される。

- ウェブ上のデータ:ウェブ上に公開されている個人情報や著作物がアルゴリズムの教育で使われた場合は、これらのデータの削除を要求できる。

アーティストや作家などが、著作物でアルゴリズムを教育することの禁止を求めているが、Altmanは、個人や著作者がこれを申請する制度の導入を計画していると説明した。

AI規制の必要性

現在、米国にはAIを規制する法律は無く、AltmanはAIを安心して利用するためには政府による規制が必要であるとの考え方を示した。

そのために、OpenAIは政府を支援する用意があり、共同で規制案を開発することを申し出た。

一方、規制を導入する際は、安全性を担保することと、AIの普及を推進するという、相反する要件の間で最適なバランスを取る必要があるとしている。

ライセンス制度を提案

Altmanは、高度なAIは認可された製品だけが販売を許される、ライセンス制度の導入を提案した。

そのため、政府はAIの安全基準を定め、企業はこれに準拠して製品を開発する。

開発したAIは第三者機関により検査され、合格した製品だけが販売を許可される。

この制度は三つのプロセスから成り:

- ライセンス:AIの安全基準を制定し、AIはこれに準拠することが求められる。基準に準拠したAIだけが販売のライセンスを得る。

- 認証試験:このため、出荷前に、AIが安全基準に準拠しているかどうかを試験する。社内だけでなく、第三者機関がこれを実施し、AIの安全性を検証する。

- 国際規格:AIの安全基準について、国際社会と協調し、統一した基準を制定する。

ソーシャルメディアの轍を踏まない

通常、連邦議会の公聴会は、議員が企業を詰問する形式で進むが、今回は異例で、親和的な雰囲気の中で意見が交わされた。

議員はOpenAIなどにアドバイスを求め、企業側は政府がAIの規制を導入することを支援するポジションを明らかにした。

この背後には、ソーシャルメディアの規制に失敗し、米国社会が混乱している実情がある。

この失敗を繰り返さないため、生成AIでは政府と企業が協力し、高度なAIを安全に活用しようという共通の目的が生まれた。

国会議員の意識の高さ

ハイテクに関する公聴会では、議員は技術を十分に理解できず、議論が上滑りするケースが少なくない。

しかし、生成AIの公聴会では、多くの議員が既にChatGPTを使っており、AIに関する理解が大きく進んでいる。

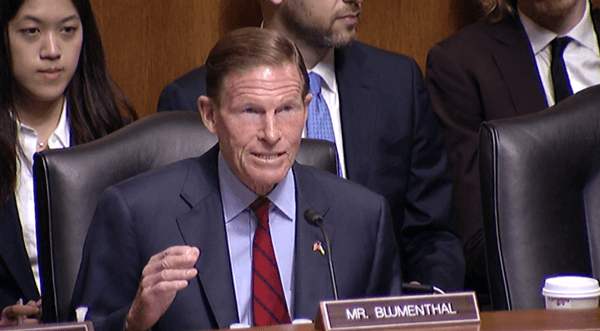

公聴会で司会を務めたブルメンソール議員(上の写真)は、開会の辞をChatGPTで制作し、それをボイスAIで本人の音声に変換し、AIが公聴会の趣旨を説明した。

国会議員は、ChatGPTの威力と危険性を把握し、AI規制の必要性を実感しており、AI規制が急ピッチで導入される機運となった。