生成AI

[No.262]ヒューマノイド・ロボットのブレークスルー、Figure AIはロボットのソーティング作業をライブ配信中、9日間連続でタスクを実行、記録がどこまで伸びるのか全米が注目新着!!

シリコンバレーに拠点を置くスタートアップ企業Figure AIはヒューマノイド・ロボット開発で業界のトップを走っている。最新モデルは「Figure 03」で信頼性が格段に向上し製造工場で活躍している。Figure AIはヒューマノイド・ロボットの性能をベンチマークするために、ソーティング作業を実施し、その様子をライブで配信している(下の写真)。

[No.261]AIIエージェントが小売店舗を経営、AIが従業員を採用しベンダーから商品を仕入れる、“AI店長”は利益を上げることができるか

サンフランシスコにAIエージェントが経営する小売店舗「Andon Market」がオープンした(下の写真)。AI店長「Luna」が店舗の経営を取り仕切り、三年間で経営を黒字化することがミッションとなる。AI店長が従業員を雇い入れ、日々のオペレーションを実行する。AI店長はベンダーと交渉し商品を仕入れる。

[No.260]緊急修正:米国政府はDeepSeek-V4を徹底検証、ベンチマーク手法に不備がありDeepSeekはモデルの性能を過大評価、米中間の技術ギャップは2か月ではなく8か月と判定

国立標準技術研究所(NIST)はDeepSeek-V4について多角的な分析を行いその結果を発表した。DeepSeek-V4はOpenAI GPT-5に匹敵する性能で、両者の技術ギャップは8か月と判定した。また、DeepSeek-V4の運用コストはGPT-5.5 Miniの半分程度で、コストパフォーマンスが優れている事実を確認した。

[No.259]DeepSeekは最新モデル「DeepSeek-V4」を投入、性能でサプライズ無し、モデルを中国製チップで開発、ソフトウェアを劇的に改良、コスパで米国モデルを凌駕する戦略

DeepSeekは最新モデル「DeepSeek-V4」をリリースし、これをオープンソースとして公開した。DeepSeek-V4の性能は米国フロンティアモデルに迫るものの、想定された範囲でサプライズは無かった。しかし、DeepSeek-V4はNvidia GPUではなく、中国製チップ「Huawei Ascend」で開発され、技術独立戦略が着実に進行していることが明らかになった。

[No.258]MetaはAIモデル「Muse Spark」を公開、ゼロから開発しアーキテクチャを一新、マルチモダルで他社をキャッチアップしたが推論機能は未完成、将来性が期待できトップ集団を猛追

Metaは新たにAI開発研究所「Meta Superintelligence Labs」を設立しフロンティアモデルの開発を進めてきた。研究所の所長はAlexandr Wangで、Zuckerbergが会社を買収するかたちで引き抜いた。Wangは28歳と若手のエリートでMetaのAI開発の総責任者となる。研究所設立後9ヶ月で最初のモデル「Muse Spark」をリリースした。

[No.257]スタンフォード大学は今年の「AI Index Report」を公開、米国と中国の技術差が急速に狭まる、米国市民はAIに脅威を感じAI規制を求める

スタンフォード大学はAIに関する総合報告書「AI Index Report」の最新版を公開した。報告書はAIを追跡調査したもので、豊富なデータに裏付けられ、AI動向を理解するためのバイブルとなる。2025年は、AI技術が脅威的なスピードで進み、同時に、米国と中国の技術ギャップが狭まった。

[No.256]Anthropicのコーディング・エージェント「Claude Code」のソースコードが流出、人気製品のAI先端技術が明らかになる、競合企業の厳しい追い上げが予想される

Anthropicのコーディング・エージェント「Claude Code」のソースコードが流出するというインシデントが起こった。Claude CodeはAIエージェント技術で、企業秘密が世界に開示された形となった。流出したソースコードにはエージェントを構成する基軸技術が含まれており、Claude Codeの人気の秘密が詳らかになった。

[No.255]AnthropicはAGIが社会にもたらすインパクトを研究する組織「Anthropic Institute」を設立、AGI社会へスムーズに移行することを目的とする

AGIのリリースが目前に迫るなか、AnthropicはAGIが社会にもたらすインパクトを研究する組織「Anthropic Institute」を開設した。AGIは社会に多大な恩恵をもたらすと期待されるが、同時に、社会構造が根本から変わり大きな混乱が予想される。Anthropic Instituteは同社のフロンティアモデルをベースに、技術・社会・経済の観点からこれを検証し、責任あるAGI開発を実施する。

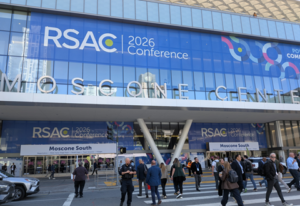

[No.254]サイバーセキュリティ最大の展示会「RSA Conference 2026」、AIエージェントの危険性に議論が集中!!CiscoはAIエージェント向けセーフティ・フレームワークを公開

サイバーセキュリティに関する世界最大の展示会「RSA Conference 2026」がサンフランシスコで開催された(下の写真)。カンファレンスの中心テーマはAIエージェントで、モデルが内包している危険性を理解し、これを如何に制御するかが議論された。企業はAIエージェントの導入を進め、このペースでいくと1兆ユニットが稼働する時代となる。

[No.253]Nvidiaは世界最大のオープンソース企業!!、AIエージェント・フレームワーク「NemoClaw」を投入、大人気モデル「OpenClaw」を企業向けに展開

Nvidiaは開発者会議「GTC 2026」をシリコンバレーで開催し(下の写真)、CEOのJensen Huangが基調講演で、オープンソースについて最新情報を解説した。AIエージェント「OpenClaw」を企業向けに提供することを発表した。OpenClawは大好評のAIエージェントで、世界で利用者数が急拡大している。