静かに、そしてスマートに。GPU導入の新常識を「液冷」で。

AquSysシリーズは、生成AI・大規模シミュレーション・HPC向けに、

データセンターGPUをデスクサイドで安全かつ静音に運用できる液冷GPUワークステーションです。

AquSysシリーズは、NVIDIA® H200 / H100 NVLなど、本来はサーバールームやデータセンターで使用される高性能GPUを、ローカル環境・デスクサイドで安全かつ快適に利用するために開発した、弊社オリジナルの液冷GPUプラットフォームです。

液冷構造により、GPUの発熱を効率的に抑え、静音性・冷却性能・長時間安定稼働を実現。

サーバールームや特別な空調設備を用意することなく、クラウドに依存しないローカル環境で、AIモデルのトレーニング、推論、大規模シミュレーションといった高負荷計算を、そのままデスクサイドで実行できます。

(展示用に光らせています)

高性能GPU導入のハードルを大きく下げる、画期的な液冷GPUプラットフォーム

──それが「AquSys」です。

AquSys 利用環境に応じて選べる3タイプ

AquSysシリーズは、設置スペース・運用スタイルの多様性に応える3タイプをご用意しています。

※ワークステーションは弊社が厳選したメーカー製を使用しています。

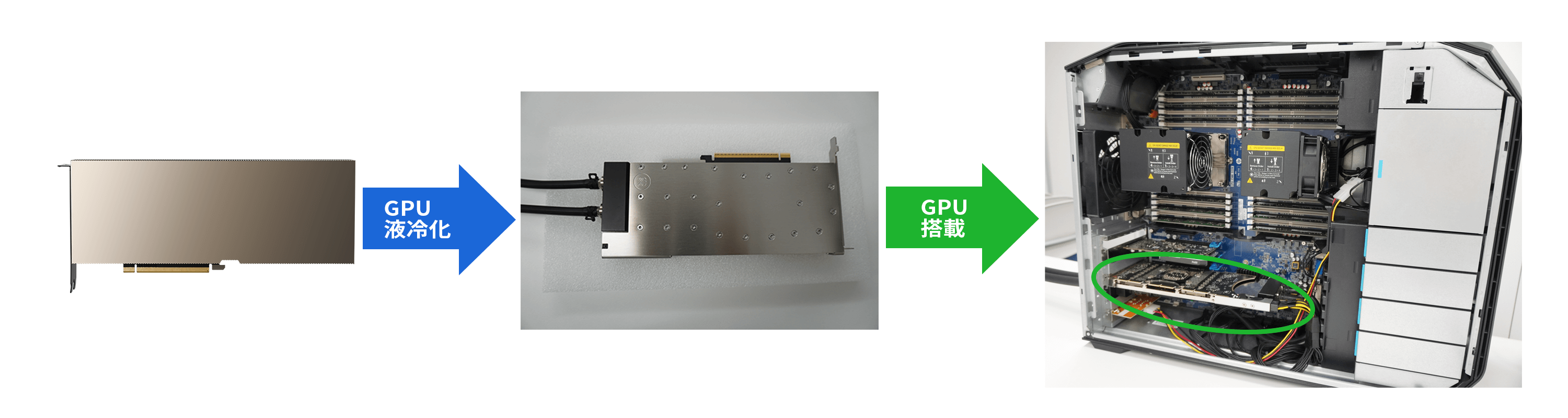

AquSysの仕組み

なぜ静かで高性能? 液冷構造の秘密

AquSysシリーズは、NVIDIA H200 / H100 NVLなどの高発熱GPUにWater Jacketを装着し、ワークステーションまたはeGPUに搭載することで、液冷による高効率な冷却を実現します。

GPUの熱は、Water Jacket内を循環する冷却液によって効率的に吸収し、

冷却液はタイプに応じて、

- セパレート/eGPUタイプでは外付けの「GPU Cooling BOX」で

- オールインワンタイプでは本体内蔵のラジエータで冷却され、再びGPUへ循環します。

これにより、安定した温度管理と高い静音性を両立し、デスクサイドでも快適なGPU運用が可能になります。

Water JacketをGPUに装着し、ワークステーションへ搭載した構成例

GPU Cooling BOX

GPU Cooling BOX(ラジエータ)は、冷却液を冷やすための装置です。

冷却液はGPUに取り付けたWater Jacket内を循環し、GPUの熱を吸収したあと、このCooling BOXに送られ、大型ファンによって効率よく冷却されます。

ファンは低速かつ一定の回転数で動作することにより、高い冷却性能と静音性の両立を実現しています。

また、GPU Cooling BOXは、ワークステーション本体から電源を供給する仕組みを採用。

これにより消費電力を抑えつつ、ワークステーションの電源ON/OFFに連動して自動的に稼働。電源の切り忘れを防ぎ、安心してお使いいただけます。

AquSys 各タイプ共通のメリット・デメリット

< 共通メリット >

ローカルAI環境でも、GPUがフル稼働しても静か。液冷ならではの快適性

AquSysは、いずれのタイプでもGPUフル稼働時でも気にならないレベルの静音性を実現しています。

液冷方式により、GPUの発熱を効率よく冷却しながら、オフィスや研究室といったローカル環境でも快適に運用可能。冷却ファンの騒音に悩まされることなく、AI開発・研究・シミュレーションに集中できる作業環境を提供します。

< 共通デメリット >

液冷化により空冷構成と比較して初期コストは上昇

液冷構成は空冷に比べて初期コストは上がりますが、性能劣化の抑制・長時間の安定稼働・故障リスク低減により、導入から廃棄までのトータルコスト(TCO)を抑える効果が期待できます。

静かすぎて「動いてる実感がない」!?(※ユニークな声としてご紹介)

ご利用中のお客様からは、

「静かすぎて本当に動いてるのか不安になる」

「GPUの音がしないので周囲に“頑張ってる感”が伝わりにくい」

といった声も。

サーバー機の騒音をご存知の方は、AquSysの静かさに驚かれることが多いようです。

※もちろん、システムはしっかり稼働していますのでご安心ください。

AquSys 搭載可能GPU

AquSysシリーズでは、NVIDIA H200 NVL や H100 NVL、RTX PRO 6000 Blackwell Server Edition といった業務用途・データセンター向けGPUを中心に、開発・検証用途としてGeForce RTX 5090の液冷構成にも対応しています。

NVIDIA H200 NVL 141GB

NVIDIA H200 NVL 141GB

NVIDIA H200 NVL 141GBは、大容量データ処理や巨大モデルを扱うワークロード向けに設計されたハイエンドGPUです。

141GBのHBM3eメモリと高いメモリ帯域により、H100世代では処理が難しかったスケールのタスクにも対応し、AIやHPC分野でさらなる性能を引き出します。

NVIDIA H100 NVL 94GB

NVIDIA H100 NVL 94GB

NVIDIA H100 NVL 94GBは、AIトレーニング、大規模言語モデル(LLM)、データ解析、HPC(ハイパフォーマンスコンピューティング)など、あらゆる分野で次世代の計算能力を提供する究極のGPUです。

94GBの大容量GPUメモリと先進的なアーキテクチャにより、これまで以上に高速で効率的な処理が可能になります。

NVIDIA RTX PRO 6000 Blackwell Server Edition 96GB

NVIDIA RTX PRO 6000 Blackwell Server Edition 96GB

NVIDIA RTX PRO 6000 Blackwell Server Editionは、NVIDIA Blackwell アーキテクチャを採用した高性能GPUで、AI推論・科学技術計算・3Dグラフィックス・映像処理など、多様なワークロードを高速化します。

96GBの超高速GDDR7メモリを搭載し、エージェントAIや物理シミュレーションなど、大規模データ処理を必要とするタスクでも卓越したパフォーマンスを発揮します。

GeForce RTX 5090 32GB

GeForce RTX 5090 は、NVIDIA Blackwell アーキテクチャを採用した最新世代のハイエンド GPU です。強化された Tensor コアと RT コアにより、生成AI、AI推論、3Dレンダリング、映像処理などのワークロードにおいて卓越した性能を実現します。

32GB の高速 GDDR7 メモリを搭載し、大規模生成AIモデルのローカル実行や、モデル評価・検証を繰り返すワークフローを効率的に処理します。高解像度レンダリングなど、大容量データを扱う処理にも対応します。

上記以外のGPUを搭載ご希望の場合は、ご相談ください。

AquSysシリーズ 仕様

AquSysシリーズは、筐体構成やGPU搭載数がタイプごとに異なり、用途や環境にあわせて最適なモデルをお選びいただけます。

ご要望やご予算を伺い、最適なGPU構成・液冷方式をご提案することも可能ですので、お気軽にご相談ください。

| セパレートタイプ | オールインワンタイプ | eGPUタイプ | |

|---|---|---|---|

| GPU搭載数 | 最大 4GPU *1 | 最大 2GPU | 最大 1GPU |

| 搭載可能GPU < 液冷GPU > | ・NVIDIA H200 NVL[141GB] ・NVIDIA H100 NVL [94GB] ・NVIDIA RTX PRO 6000 Blackwell Server Edition [96GB] | ・NVIDIA H200 NVL[141GB] ・NVIDIA H100 NVL [94GB] ・NVIDIA RTX PRO 6000 Blackwell Server Edition [96GB] ・Geforce RTX 5090 [32GB] | |

| 搭載可能GPU < 空冷GPU > | ー | ー | ・NVIDIA RTX PROシリーズ ・NVIDIA GeForce RTX 5090/4090 *2 など |

| 筐体(ワークステーション) | HP Z4 G5 Workstation HP Z8 G5 Workstation HP Z8 Fury G5Workstation | 1CPUモデル:Supermicro SYS 551A-T Workstation 2CPUモデル:Supermicro SYS 741A-I Workstation | 既存のワークステーションをご利用いただくか、または ワークステーションの同時購入も可能 |

| 提供形態 | 買取 / レンタル | ||

| その他 | セパレートタイプは、すでにお持ちのワークステーションに、 液冷化したGPUと外付けの「GPU Cooling BOX」を後付けすることもできます。ご相談ください。 | オールインワンタイプは、故障時の原因特定に時間を要する可能性があります。 レンタルでの故障時は代替機との交換になります。 | eGPUタイプは、単体利用だけでなく、セパレートタイプやオールインワンタイプと組み合わせて使用できます。 |

| 詳細スペック | セパレートはこちら | オールインワンはこちら | eGPUはこちら |

*1: セパレートタイプは最大4GPU搭載可能ですが、NVIDIA H200 /H100 NVLについては、表示用GPUを搭載する場合、最大3GPUとなります。

*2: GeForce RTX 5090 / 4090の空冷GPUを eGPUタイプに搭載する場合、GPU本体のファンによる動作音が発生します。液冷GPU構成のような静音性は得られませんので、あらかじめご了承ください。

AquSys ホワイトペーパー

AquSysシリーズ 各モデルの特長や、サーバー環境との比較などをまとめた資料となります。

ぜひご覧ください。登録不要でご覧いただけます。

目次

01 はじめに

02 そもそも「NVIDIA H200/H100」がオフィスで稼働できないワケ

03 研究室・デスクサイドで使える液冷GPUワークステーション「AquSys」

04 利用スタイルで選ぶ、AquSysシリーズ3つのラインナップ

05 AquSys 3タイプ比較表(セパレート/オールインワン/eGPU)

06 研究・開発現場での活用導入例

07 サーバー環境 vs 液冷GPUワークステーション「AquSys」

AquSys よくある質問(FAQ)

サーバールームや特別な空調設備は必要ですか?

必要ありません。

AquSysシリーズはデスクサイド設置を前提に設計しており、サーバールームや専用空調を用意せずに運用できます。

オフィスや研究室などのローカル環境で、高性能GPUを活用したAI・HPC処理が可能です。

AquSysシリーズはどのような用途に向いていますか?

生成AI(LLMの学習・推論)、AIエージェント処理、CAE・シミュレーション、HPC、3Dレンダリングなど、長時間・高負荷の演算処理を安定して実行したい用途に適しています。

データを外部に出さず、ローカル環境で処理したい企業・研究用途にも多く採用されています。

液冷方式を採用するメリットは何ですか?

液冷方式は、GPUの発熱を効率的に処理できるため、高負荷時でも温度が安定しやすく、性能を持続的に引き出しやすい点が特長です。

これにより、本来はデータセンターやサーバー環境での利用を前提としたNVIDIA H200 / H100 NVL などの高性能GPUを、オフィスや研究室といったローカル環境でも静音かつ安定して運用できます。

レンタルやリースでの導入は可能ですか?

はい、可能です。

購入だけでなく、レンタル・リースにも対応しています。

検証用途や短期プロジェクトから本格導入まで、柔軟に選択できます。

どの構成を選べばよいか相談できますか?

もちろん可能です。

用途、設置環境、予算、将来の拡張計画を踏まえて、最適なGPU構成・冷却方式・筐体タイプをご提案します。

見積依頼・お問い合わせはこちら

製品に関するご質問・ご相談など、お気軽にお問い合わせください。

NVIDIA認定パートナー「GDEPソリューションズ」は、

お客様の用途に最適な製品のご提案から導入までサポートします。