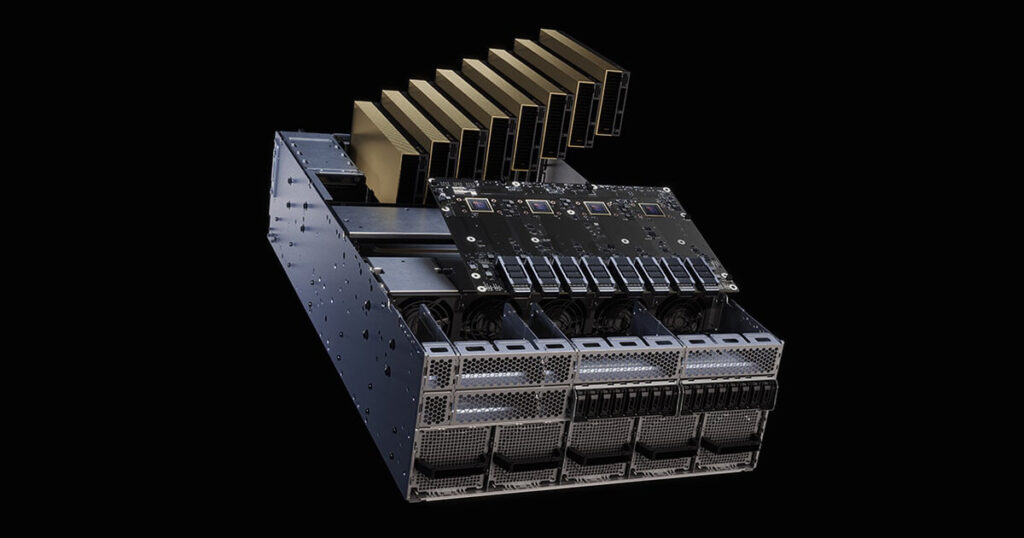

データセンターで使うために最適化されたRTX PRO Blackwell

NVIDIA RTX™ PRO 6000 Blackwell Server Editionは、生成AI、LLM、AIエージェントの推論処理と高度な可視化を、データセンターやオンプレミスサーバーで安定して実行するために設計されたプロフェッショナルGPUです。

96GBの大容量GDDR7メモリとBlackwellアーキテクチャを採用し、AI推論、ビジュアライゼーション、映像処理といった複数のワークロードを1枚のGPUで効率よく集約できる点が大きな特長です。

NVIDIA RTX PRO 6000 Server Editionが選ばれる理由

NVIDIA RTX PRO 6000 Server Editionは、ワークステーション向けRTX PRO 6000をベースにしつつ、

サーバーやデータセンターでの常時稼働・リモート利用を前提に最適化されたモデルです。

- サーバー筐体への搭載を想定

- 仮想化・リモート可視化・AI推論向け

- データセンター環境での安定運用を重視

オンプレミス環境やプライベートクラウドにおいて、AIとグラフィックスを統合的に提供するGPUとして位置づけられます。

NVIDIA RTX PRO 6000 Server Edition 特長

1. BlackwellアーキテクチャによるAI推論と可視化の高い両立

NVIDIA RTX PRO 6000 Blackwell Server Editionは、最新のBlackwellアーキテクチャを採用しています。

第5世代Tensorコアと第4世代RTコアにより、生成AIや大規模言語モデル(LLM)、AIエージェントの推論処理と、高品質な3D可視化・レンダリングを同一GPU上で効率よく実行できます。

AI推論専用GPUと可視化GPUを分ける必要がなく、1台のサーバーでAIとグラフィックスを統合的に運用できる点が大きな特長です。

2. 96GB GDDR7メモリによる大規模ワークロード対応

96GBの大容量GDDR7メモリを搭載しており、モデルサイズやデータ量が大きいワークロードでもGPUメモリ上に保持しやすくなっています。

これにより、

- LLMやマルチモーダルAIの推論

- AIエージェントにおける長いコンテキストの保持

- 高解像度・高精度な3Dデータの可視化

など、メモリ容量がボトルネックになりやすい処理を安定して実行できます。

3. サーバー常時稼働を前提とした設計

RTX PRO 6000 Server Editionは、データセンターやオンプレミスサーバーでの常時稼働を前提に設計されています。

- パッシブ冷却方式によるサーバー筐体への適合

- 複数GPU搭載構成への対応

- 長時間連続運用を想定した安定性

ワークステーション用途とは異なり、サーバーにGPUを集約して利用する環境に適した設計となっています。サーバー集約型のGPU利用に適した設計が特長です。

4. マルチインスタンスGPUによる柔軟なリソース分割

マルチインスタンスGPU(MIG)機能により、1枚のGPUを複数の独立したGPUインスタンスとして分割できます。

これにより、

- 複数のAI推論サービスを同時に実行

- 部署や用途ごとにGPUリソースを分離

- AI推論と可視化処理を並行して実行

といった データセンター運用に適したGPU共有が可能になります。

5. 仮想化・リモート可視化に最適

RTX PRO 6000 Blackwell Server Editionは、

仮想デスクトップやリモート可視化環境での利用にも適しています。

GPUをサーバー側に集約し、ネットワーク越しに高性能GPU環境を提供することで、

- 設計・開発拠点の分散

- セキュアなリモート業務

- 高性能GPUの効率的な共有

といった運用を実現します。

6. AI時代のサーバーGPUとしての拡張性

PCIe Gen5に対応することで、CPUやストレージとのデータ転送性能が向上しています。AI推論、データ解析、可視化など、データ転送量の多いワークロードにおいて、システム全体のスループット向上に貢献します。

参考販売価格:1,990,000 円(税込 2,189,000 円)

短期レンタル価格:324,000 円/月(税込 356,400 円/月)

長期1年レンタル価格:145,000 円/月(税込 159,500 円/月)

発売時期:2025年12月

レンタルの詳細はこちら

NVIDIA RTX PRO 6000 Server Edition 主な用途

- 生成AI・LLM・AIエージェントの推論実行基盤

- AI推論サービスのサーバー集約

- 仮想ワークステーション、リモート可視化

- 3D設計、CAE、シミュレーションの集中処理

- 映像処理・ビジュアライゼーション基盤

RTX PRO 6000シリーズの位置づけ

RTX PRO 6000 Blackwell Server Editionは、同じBlackwell世代のRTX PRO 6000シリーズの中でも、「複数ユーザー・複数ワークロードでGPUを使い切る」ことを前提に設計されたモデルです。

◆ NVIDIA RTX PRO 6000 Blackwell Workstation Edition

<性能重視> 個別ユーザーが1台で最大性能を引き出す用途に最適

◆ NVIDIA RTX PRO 6000 Blackwell Max-Q Workstation Edition

<省電力重視> 高密度構成・省電力を重視したワークステーション向け

◆ NVIDIA RTX PRO 6000 Blackwell Server Edition

<共有・運用重視> 仮想化・GPU共有・24時間稼働を前提とし、AI開発基盤や部門横断利用など、組織全体でGPUを効率的に活用するためのサーバー向けモデル

RTX PRO 6000シリーズは、用途やシステム構成に応じた選択が可能です。

NVIDIA RTX PRO 6000 Server Edition 性能・スペック

| NVIDIA RTX PRO 6000 Server Edition | |

| GPUアーキテクチャ | NVIDIA Blackwell アーキテクチャ |

| GPUメモリ | 96 GB GDDR7 (ECC付き) |

| メモリバンド幅 | 1,597 GB/秒 |

| メモリインターフェイス | 512 ビット |

| 消費電力 | 最大600W |

| マルチインスタンス GPU | 最大4 個のMIG @ 24GB |

| NVENC | NVDEC | JPEG | 4x | 4x | 4x |

| コンフィデンシャル コンピューティング | サポート |

| Root of TrustによるSecure Boot | 対応 |

| グラフィック バス | PCI Express 5.0 x16 |

| ディスプレイ コネクタ | 4x DisplayPort 2.1 |

| フォーム ファクター | 4.4" (H) x 10.5" (L) デュアルスロット |

| 電源コネクタ | PCIe CEM5 16-pin x1 |

| CUDA 並列処理コア | 24,064 |

| NVIDIA Tensor コア | 752 (第 5 世代) |

| NVIDIA RT コア | 188 (第 4 世代) |

| 単精度演算性能 (FP32) | 117 TFLOPS |

| ピーク FP4 AI PFLOPS | 3.7 PFLOPS |

| RT コア性能 | 354.5 TFLOPS |

*仕様は変更される場合があります。

NVIDIA GPU 一覧表PDF

弊社で取り扱っているNVIDIA GPUの性能・スペックを一覧にしました。

PDFファイルをダウンロードすることができます。

よくある質問

NVIDIA RTX PRO 6000 Server Editionは、ワークステーション版と何が違いますか。

NVIDIA RTX PRO 6000 Server Edition とワークステーション版は、GPU性能やメモリ容量は同じです。違いは、Server Edition がサーバー筐体の強いエアフローで使う前提のため、パッシブ冷却と高い消費電力で動作する点です。

NVIDIA RTX PRO 6000 Server Editionは、どのような用途に向いていますか。

生成AIや大規模言語モデル(LLM)、AIエージェントの推論実行、仮想ワークステーション、リモート可視化など、高い安定性が求められるGPU利用に適しています。

NVIDIA RTX PRO 6000 Server Editionは、電源や設置環境に制約はありますか。

はい。RTX PRO 6000 Server Editionは高性能・高消費電力GPUのため、搭載する筐体構成やGPU枚数によっては、電源容量や設置環境に配慮が必要となります。

利用環境に応じた最適な構成をご提案しますので、詳細はお問い合わせください。

NVIDIA RTX PRO 6000 Server Edition

搭載おすすめGPUシステム

液冷GPUワークステーション「AquSysシリーズ」

AquSysは、NVIDIA RTX PRO 6000 Server Editionをはじめとするデータセンター向け高性能GPUを、液冷により静音・安定運用し、専用サーバーを必要とせず利用できるGPUワークステーションです。

※NVIDIA RTX PRO 6000 Server Editionに対応したサーバータイプの筐体については、お問い合わせください。

お気軽にご相談ください!

製品に関するご質問・ご相談など、お気軽にお問い合わせください。

NVIDIA認定パートナー「GDEPソリューションズ」は、

お客様の用途に最適な製品のご提案から導入までサポートします。